di Eleonora Converti*

Gli aspetti etici dell'intelligenza artificiale (IA) e della robotica sono di fondamentale importanza sia nel presente che nel futuro, poiché influenzano profondamente la società, la cultura e l'etica stessa. La comunità globale deve lavorare insieme per sviluppare linee guida e regolamenti che garantiscono che l'IA e la robotica siano utilizzate in modo responsabile e benefico per l'umanità.

Negli ultimi anni l’Intelligenza Artificiale ha segnato progressi rapidi e inimmaginabili ed è sempre più pervasiva in una vasta gamma di applicazioni. Si pensi alla guida autonoma, il riconoscimento facciale, la diagnosi medica, il supporto decisionale, le Chatbot.

Occorre distinguere due tipi di intelligenze artificiali:

- l’Intelligenza Artificiale classica che si basa su algoritmi che utilizzano l’apprendimento supervisionato, in cui un modello viene addestrato su un insieme di dati etichettati per fare previsioni o classificazioni;

- l’Intelligenza Artificiale generativa che mira a generare nuovi contenuti, basandosi sulle reti neurali artificiali in grado di generare dati, immagini, testi o suoni che sembrano provenire da fonti reali.

Tuttavia, con il crescente impiego delle diverse forme dell’Intelligenza Artificiale sorgono di pari passo preoccupazioni di natura etica in quanto sono da considerarsi imprescindibili temi come sicurezza, responsabilità, trasparenza, bias culturali. Notevoli saranno le implicazioni nell’ambito della conoscenza. Infatti, quando la tecnologia si afferma esclusivamente attraverso modelli proprietari spesso assunti a fonti uniche e globali, mai contraddette, il rischio è di una visione unica ed acritica di fatti, di problematiche e di visioni del mondo. Insieme alla crescita pervasiva delle tecnologie occorre dunque preservare la diversità dei nostri sistemi di conoscenza e soprattutto allineare l’intelligenza delle macchine ai valori umani. Come afferma Stefania Giannini nella relazione UNESCO dell’11 luglio 2023, “è in gioco il nostro benessere, forse anche la nostra sopravvivenza. Il nostro lavoro deve essere improntato all’urgenza e dobbiamo impegnarci insieme per garantire che i nostri sistemi educativi svolgano un ruolo chiave nella transizione dell’umanità verso un mondo basato sull’AI”.

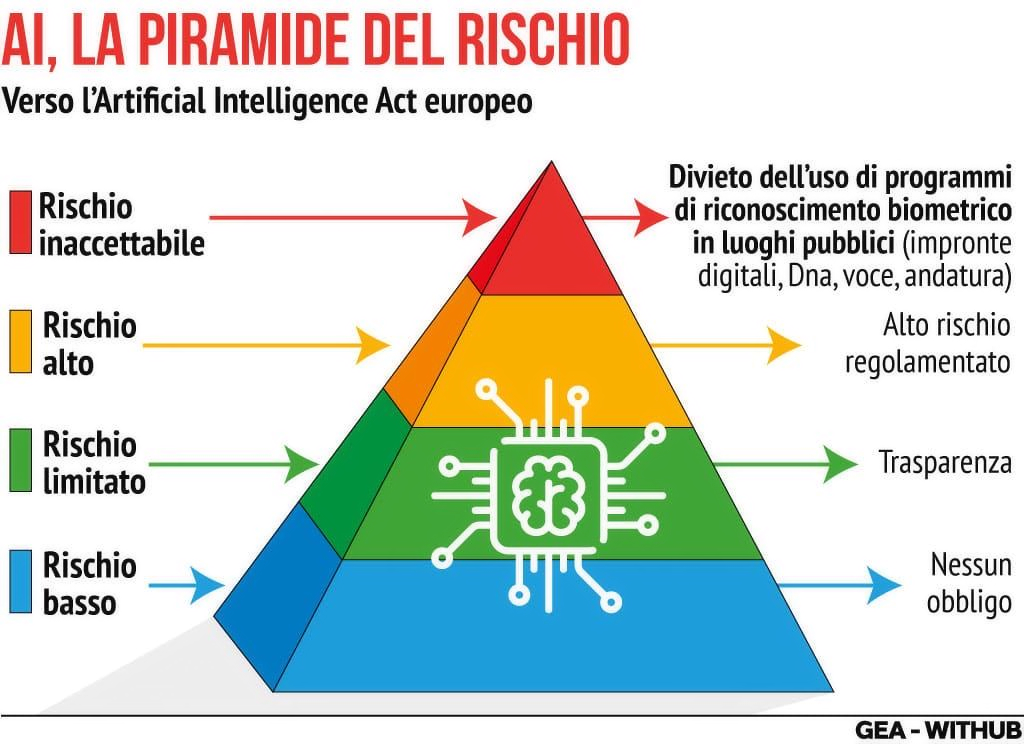

Per affrontare queste questioni etiche è fondamentale un coinvolgimento delle comunità scientifiche, dei governi, del tessuto produttivo e della società civile. Il 14 giugno 2023 il Parlamento Europeo, in seduta plenaria, ha approvato l’Artificial Intelligence Act, il documento che contiene le prime regole al mondo in materia di intelligenza artificiale. Tali regole mirano a garantire la sicurezza, la trasparenza e l’etica dell’intelligenza artificiale in Europa. L’Artificial Intelligence stabilisce che sono assolutamente vietati:

-

sistemi di identificazione biometrica: remota “in tempo reale” in spazi accessibili al pubblico; a distanza “a posteriori” (eccetto perseguimento di reati gravi e solo su autorizzazione giudiziaria);

-

sistemi categorizzazione biometrica che utilizzano caratterizzazioni sensibili (ad esempio sesso, razza, etnia, cittadinanza religione, orientamento politico);

-

sistemi di polizia predittiva basati su profili, ubicazioni o comportamenti criminali passati;

-

riconoscimento delle emozioni nelle forze dell’ordine, nella gestione delle frontiere, nei luoghi di lavoro, nelle istituzioni scolastiche;

-

scraping non mirato di immagini facciali da internet o da filmati di telecamere a circuito chiuso per creare database di riconoscimento facciale.

Inoltre i fornitori di modelli di base come ChatGPT e AI generativa dovranno rispettare i requisiti di trasparenza (dichiarando che il contenuto è stato generato dall’IA), aiutando anche a distinguere le cosiddette immagini deep-fake e da quelle reali, e fornire salvaguardie per evitare la generazione di contenuti illegali. Dovrebbero inoltre essere pubblicate le sintesi dettagliate dei dati protetti dal diritto d’autore utilizzati per l’addestramento.

Sono inoltre confermati i quattro livelli di rischio delle Intelligenze artificiali:

La legge Europea sull’AI è la più importante normativa sull’intelligenza artificiale al mondo e sicuramente nel breve periodo creerà un precedente significativo che indurrà tutti gli stati del mondo a recepirne il significato ed adottare analoghe regolamentazioni.

Restano tuttavia aperte nuove sfide e nuovi temi.

Il testo definitivo della legge non sarà approvato prima della fine dell’anno. Durante le riunioni di “trilogo”, che precedono l’approvazione definitiva del testo, organizzate dal Consiglio, dal Parlamento e dalla Commissione si svolgono negoziazioni sempre complesse a causa sei molteplici interessi in gioco. Si pensi alle lobbing di aziende come Open AI che non vorrebbero far classificare le AI general purpose come sistemi ad alto rischio. Il testo così com’è è, inoltre, perfettibile: non sono incluse, tra le pratiche illegali, il riconoscimento facciale e la profilazione discriminatoria di individui nell’ambito dei respingimenti dei migranti alle frontiere. La battaglia per una società libera e democratica in cui tutti i diritti fondamentali vengano rispettati si spera venga vinta completamente.

*docente di Sistemi Automatici presso l’ITIS “E.Fermi” di Castrovillari