di Mario Catalano

Ricercatore, Docente, Editore Scientifico.

Abstract: L’intelligenza artificiale e la robotica, nell’ambito delle tecnologie emergenti, colpiscono notevolmente l’immaginario collettivo a motivo della loro risonanza mediatica e dell’interesse suscitato nel mondo della cinematografia. È sempre più diffuso il convincimento che ne possa derivare uno straordinario potere per l’uomo, ma anche il rischio di un conflitto epocale tra esseri umani e artificiali. Se tali scenari possono considerarsi frutto di suggestioni mediatiche e lacune formative, è pur vero che la nascente “era delle macchine” porta con sé preziose opportunità e grandi sfide di natura etico-giuridica. Pertanto, è ormai ineludibile che gli studenti, sin dagli anni della scuola di base, abbiano la possibilità di familiarizzare con la logica del machine learning, ma anche – e soprattutto! – di prender coscienza dei suoi rischi reali, alla luce di una visione chiara della differenza essenziale tra umano e téchne, nonché delle relazioni possibili tra le due realtà.

Questo articolo illustra un’innovativa proposta curricolare sulla dimensione etica delle tecnologie emergenti, con particolare riferimento all’intelligenza artificiale, che è stata ideata e sperimentata (Fig. 1) dalla ricercatrice Blakeley Payne (Payne,2019) in collaborazione con il gruppo Personal Robots del Massachusetts Institute of Technology Media Lab.

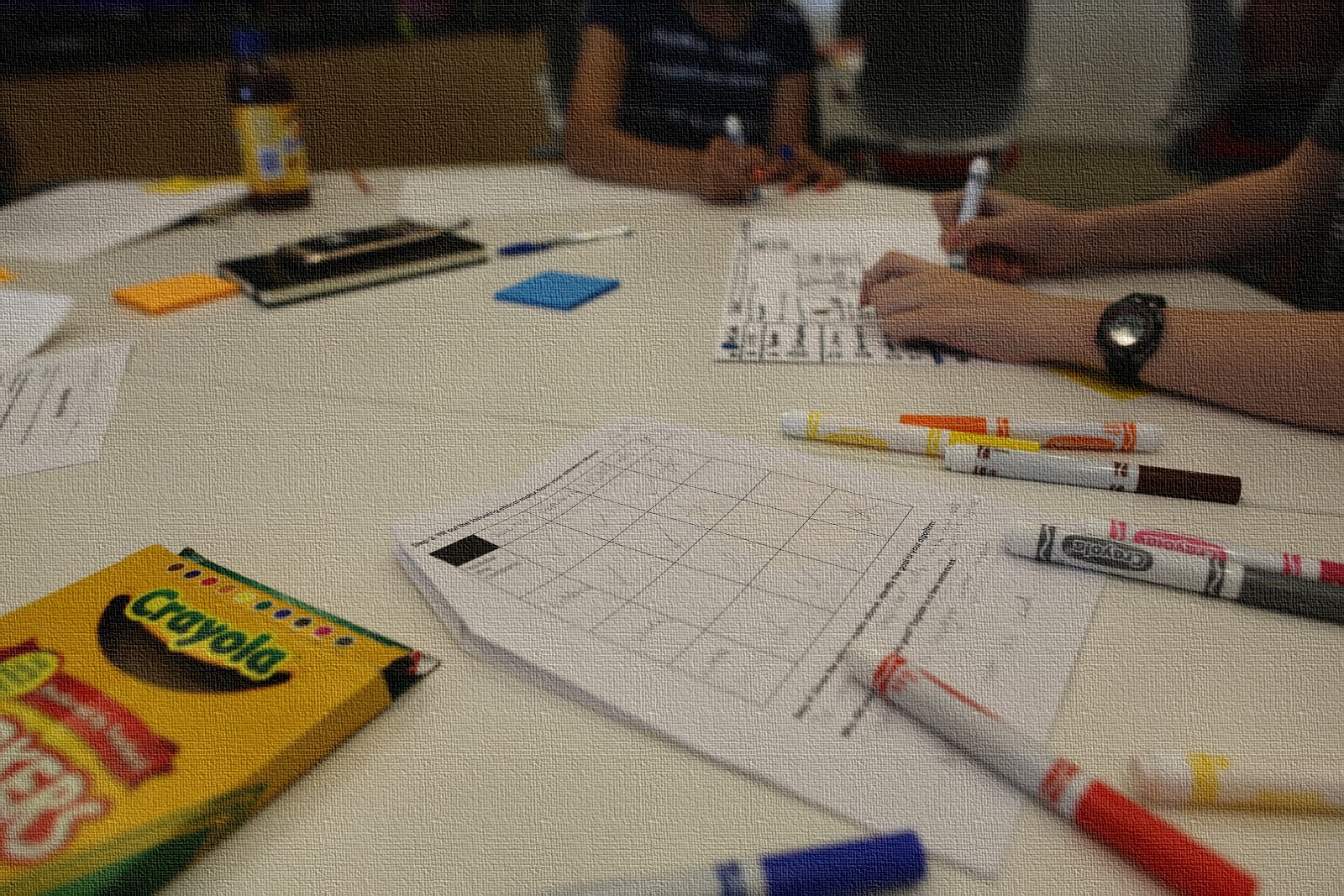

Fig. 1:. Gruppo di studenti che, nel 2019, hanno sperimentato il curriculum sulla dimensione etica dell’intelligenza artificiale ideato da Blakeley H. Payne con il supporto del MIT Media Lab Personal Robots Group (fonte: https://www.media.mit.edu/projects/ai-ethics-for-middle-school/overview/)

Il curricolo è stato concepito per gli studenti dai 9 ai 14 anni e mira al conseguimento di alcuni traguardi formativi coerenti con le profonde trasformazioni del nostro tempo:

- essere consapevoli che le tecnologie digitali rappresentano un nuovo alfabeto… un mezzo per esprimere la propria creatività, le proprie idee… sé stessi, nonché uno strumento potente per contribuire al progresso umano, lavorando con e per gli altri.

- Conoscere le caratteristiche fondamentali di un algoritmo e sapersene avvalere per affrontare problemi nuovi, scomponendoli in compiti elementari.

- Saper sviluppare semplici ed efficaci modelli di machine learning.

- Capire che i sistemi d’intelligenza artificiale, nel perseguire gli scopi prescelti dai loro creatori, possono influenzare in modo diverso i gruppi d’interesse in gioco (Awad et al., 2018).

- Saper immaginare e progettare, in modo semplice, gli aspetti essenziali di nuove applicazioni d’intelligenza artificiale, che rispondano a precisi bisogni della collettività.

Nel corso della sperimentazione, gli studenti coinvolti sono stati guidati nelle comprensione dei tratti distintivi di un algoritmo, facendo riferimento alla vita di tutti i giorni. In particolare, attraverso la “riscoperta” del concetto di ricetta per la preparazione di uno snack, hanno imparato che un algoritmo è una sequenza ordinata d’istruzioni elementari non ambigue per trasformare uno o più input in qualcosa di utile (output). Interessante, poi, l’attività laboratoriale cui è approdata questa prima fase: ossia la stesura, da parte dei ragazzi, di un algoritmo per la preparazione del “miglior” panino al burro di arachidi e gelatina. Notevoli gli effetti sull’apprendimento: gli allievi hanno esplorato il significato dell’espressione “migliore” – migliore … per chi? Per colui che consumerà il sandwich? Per i suoi genitori? – e hanno verificato come un algoritmo possa cambiare a seconda del punto di vista che intende riflettere. Hanno, altresì, appreso ad avvalersi delle matrici etiche per individuare tutte le possibili relazioni tra stakeholder e loro interessi, in gioco nella creazione di un algoritmo: si tratta di rappresentazioni tabellari le cui celle si riferiscono a diverse combinazioni tra portatori d’interesse ed obiettivi (ad es. child-taste, parents-nutrition, parents-cost, etc.).

È stato, questo, un momento cruciale del percorso, in grado di veicolare il messaggio della non neutralità di una tecnologia, spesso destinata ad influire su molteplici soggetti con obiettivi, anche solo parzialmente, in conflitto. È stato, inoltre, il primo decisivo passo verso il riconoscimento che tutti abbiamo la possibilità e la responsabilità di plasmare il mondo per il bene comune attraverso idee, creatività e tecnologie… facendone, così, il luogo della piena espressione dell’umano.

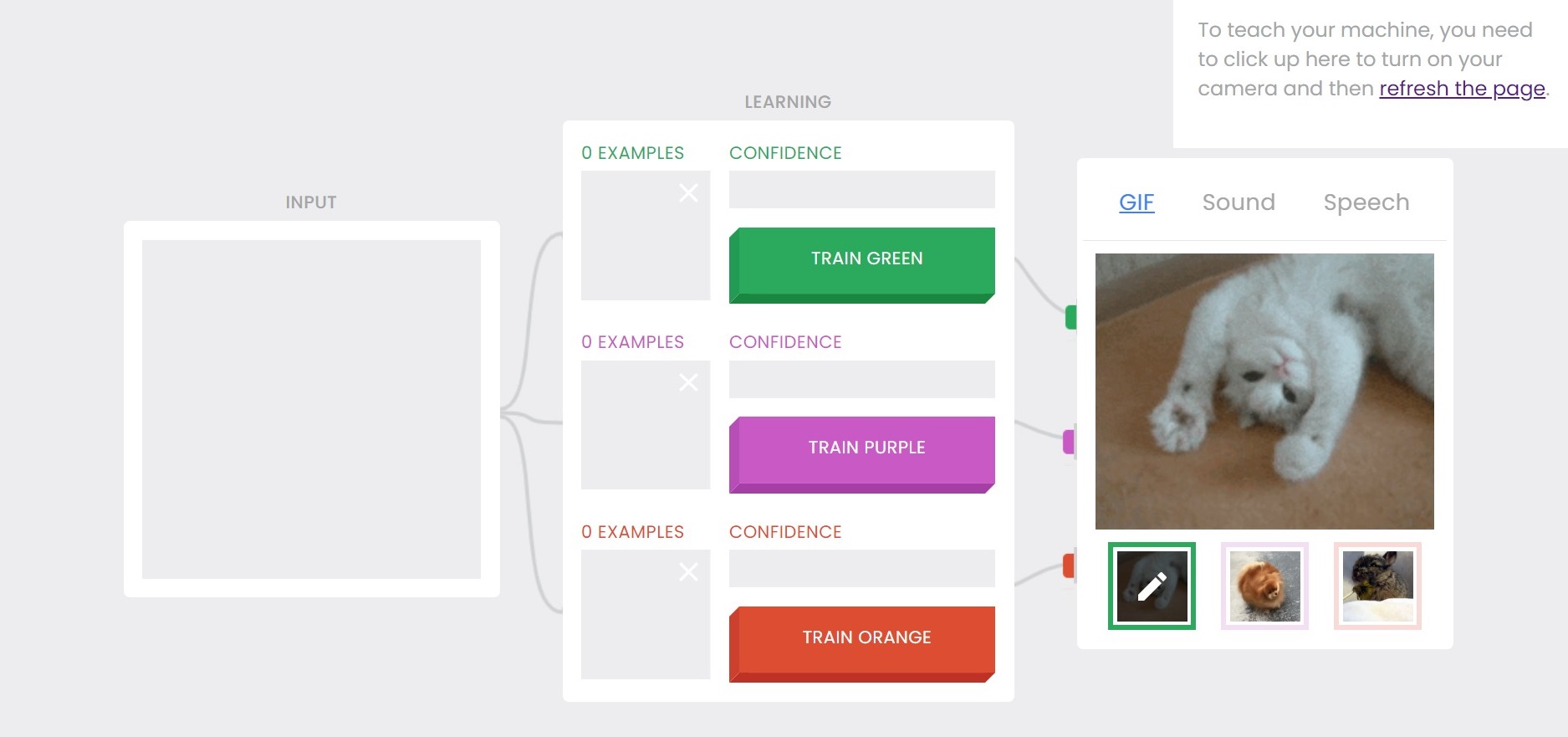

In una fase successiva, gli studenti hanno iniziato a conoscere la realtà del machine learning attraverso una piattaforma per lo sviluppo di modelli di classificazione (AI-based) fruibile anche dai non esperti, Google Teachable Machine.(Fig. 2). Questa consente il caricamento on-line di campioni d’immagini, riferibili alle categorie che la macchina deve “imparare” a riconoscere, e “l’addestramento” automatico del relativo modello d’intelligenza artificiale. I coach della sperimentazione hanno fatto sì che i ragazzi “inciampassero” nel problema del bias algoritmico: infatti, hanno dato loro un campione d’immagini di cani e gatti che, essendo poco diversificato per la prima categoria, permetteva una classificazione accurata soltanto dei gatti. A loro il compito d’integrare le osservazioni, eliminare l’asimmetria e migliorare l’efficacia complessiva del modello, maturando, così, una prima comprensione della logica sottesa ad un algoritmo di machine learning.

Nella parte finale dell’esperienza, gli allievi hanno analizzato i sistemi d’intelligenza artificiale e la relativa dimensione etica di un’applicazione reale, YouTube. Si sono impegnati nell’identificazione dei target da prevedere e dei dati utili per l’addestramento dei modelli di previsione, relativamente a diverse funzioni della popolare piattaforma di video sharing: raccomandazione personalizzata dei contenuti multimediali, classificazione dei commenti, marketing calibrato sugli interessi dei fruitori, etc. Un approfondimento è stato dedicato all’algoritmo delle raccomandazioni, assegnando agli allievi il compito di progettarne un’evoluzione attraverso matrici etiche e semplici prototipi delle interfacce grafiche. Per coronare questa fase conclusiva, è stato animato un confronto tra i ragazzi su un articolo del Wall Street Journal in cui si rendeva pubblico un dibattito, interno a YouTube, circa la sicurezza digitale dei più piccoli utenti della piattaforma.

Fig. 2: Interfaccia grafica della piattaforma per lo sviluppo di modelli di machine learning “Google Teachable Machine” (fonte: https://teachablemachine.withgoogle.com/v1/).

Fig. 3:. Un paio di studenti del progetto “MIT AI Ethics Education Curriculum” lavorano su matrici etiche e su una nuova versione di YouTube (fonte: https://www.media.mit.edu/projects/ai-ethics-for-middle-school/overview/)

BIBLIOGRAFIA:

- Awad, E., Dsouza, S., Kim, R., Schulz, J., Henrich, J., Shariff, A., Bonnefon, J., and Rahwan, I (2018). “The Moral Machine experiment”, Nature 563, 7729, 59.

- Benanti, P. (2018). Le Macchine sapienti - Intelligenze artificiali e decisioni umane. Casa Editrice Marietti.

- Payne H., B. (2019). An ethics of artificial intelligence curriculum for middle school students (with support from the MIT Media Lab Personal Robots Group, directed by Cynthia Breazeal).

- Chiriatti, M. (2021). Incoscienza artificiale – Come fanno le macchine a prevedere per noi. Luiss University Press.